El 24 de enero de 2023 la Fiscalía imputó en Cali a Osbert Orozco Pérez por dos cargos: actos sexuales con menor de catorce años y acceso carnal abusivo, ambos agravados. El Juzgado Noveno de Garantías de la ciudad le impuso prisión domiciliaria.

Menos de tres meses después, la Fiscalía lo acusó. El Juzgado Séptimo Penal del Circuito de Cali lideró el juicio contra Orozco desde septiembre de 2024. El 19 de septiembre de 2025 estaba programada la audiencia de alegatos de conclusión.

Cuando la defensa del procesado intentaba preparar su última intervención del caso, encontró un archivo extraño en el expediente: una sentencia condenatoria a dieciocho años de prisión. El juicio no había terminado, la decisión ya estaba escrita.

El documento valoraba pruebas, tenía conclusiones y ya tenía la firma de la juez Dolly Rocío Chávez Escobar. Era un prejuzgamiento. La togada tenía listo su veredicto, que ni siquiera había sido escrito por ella, sino por la inteligencia artificial.

La defensa de Orozco recusó a la juez, que el primero de octubre declaró infundado el recurso. Seis días después, otro juzgado también lo rechazó. Osbert Orozco acudió a una tutela, pues estuvo a punto de ser sentenciado sin un juicio concluyente.

Una sentencia escrita antes de los alegatos

Orozco alegó vulnerados sus derechos fundamentales al debido proceso y a la defensa. El Tribunal Superior de Cali le dio trámite a la demanda. La juez Cháves se defendió asegurando que la potencial sentencia apareció “por un error involuntario”.

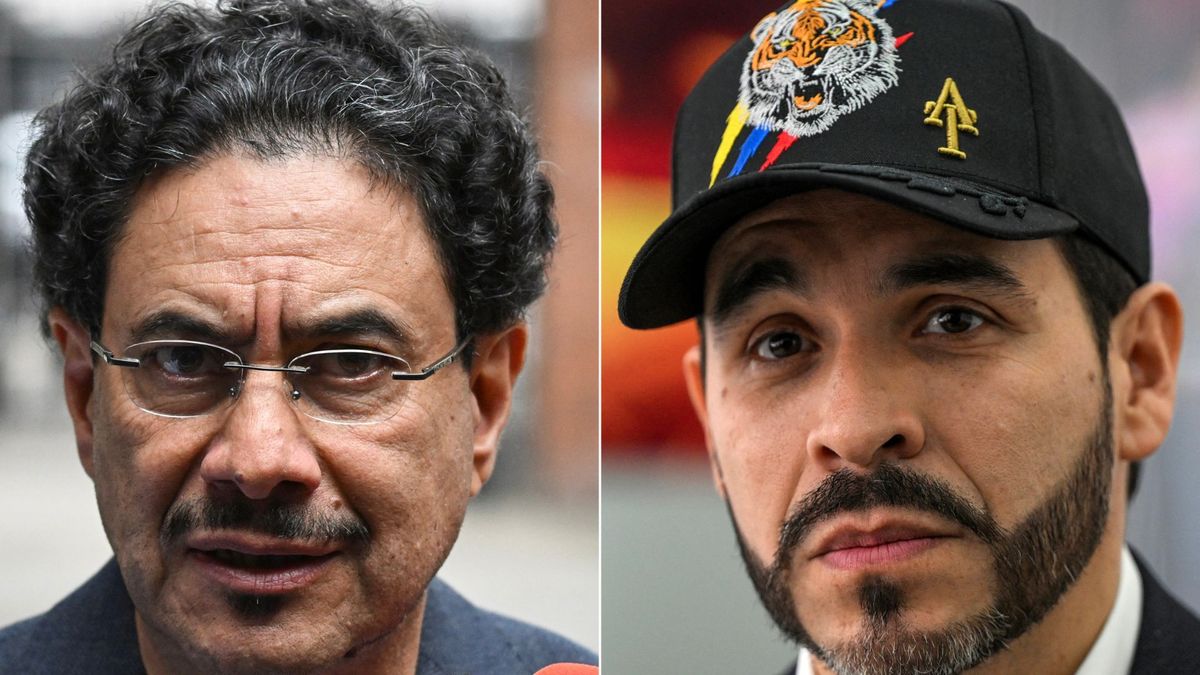

El Tribunal rechazó la tutela. El acusado impugnó. La Corte Suprema de Justicia zanjó el debate. Con ponencia del magistrado José Joaquín Urbano y una sentencia de veintiséis páginas, la Corte reprochó el uso desmedido de la inteligencia artificial.

“Lo más sorprendente es que dicho análisis estaba expresamente orientado a la emisión de una sentencia condenatoria, lo cual desborda por completo los usos permitidos de estas tecnologías en el ámbito judicial”, recalcó la Sala Penal.

Aunque la inmersión de la inteligencia artificial en la justicia poco a poco se ha consolidado —y ha sido objeto de análisis académicos o incluso pronunciamientos jurídicos—, la doctrina y las instituciones competentes han planteado ciertos límites.

El Acuerdo PCSJ24-12243, del Consejo Superior de la Judicatura —la entidad rectora en materia administrativa de la Rama Judicial— adopta varios límites para que la IA no sustituya la verificación minuciosa de los funcionarios y los estándares éticos.

La Corte fija límites del uso de la IA en la justicia

La misma normativa prohíbe que la inteligencia artificial supla las valoraciones de las pruebas. “Si bien el juez puede acudir a sistemas de IA cuando ello resulte necesario y pertinente, su utilización debe ser razonada y ponderada”, remarca la Corte.

El fallo, marcado como STP27973-2025, subraya que la IA debe estar “orientada a la protección de los derechos fundamentales y sujeta a buenas prácticas, criterios éticos y respeto por los mandatos superiores”. De lo contrario, su uso sería “imprudente”.

“La inteligencia artificial solo puede utilizarse en labores propias de la administración de justicia en tanto no sustituya funciones jurisdiccionales indelegables, en especial aquellas que exigen razonamiento humano”, llamó la atención la sentencia.

José Joaquín Urbano, Gerardo Barbosa Castillo y Hugo Quintero Bernate, por unanimidad, revocaron el fallo del Tribunal Superior de Cali y concedieron el amparo de Osbert Orozco. Su caso pasó a otro juzgado. La juez Chávez resultó regañada.

Y la Corte sentó un precedente clave. Como el de noviembre de 2025, cuando la Sala de Casación Civil, también a través de una tutela, anuló un fallo que desde Sucre utilizó citas atribuidas a la jurisprudencia que eran “un contenido inexistente”.