La inteligencia artificial empieza a ocupar un lugar cada vez más visible en las operaciones militares contemporáneas, incluyendo acciones recientes relacionadas con Venezuela. Para Peter Asaro, presidente del Comité Internacional para el Control de las Armas Robotizadas, el uso de estos sistemas plantea interrogantes legales y éticos que todavía no han sido resueltos. En entrevista con La FM, el experto explicó cómo la inteligencia artificial ya participa en procesos de identificación de objetivos militares y por qué su expansión genera preocupación internacional.

Según Asaro, uno de los principales riesgos está en el desarrollo de sistemas de armas completamente autónomos capaces de tomar decisiones de vida o muerte sin supervisión humana. “Estamos muy preocupados por el potencial de sistemas de armas totalmente autónomos que puedan identificar y seleccionar objetivos y atacarlos sin supervisión humana”, señaló el investigador, quien explicó que durante más de una década organizaciones internacionales han intentado impulsar un tratado en las Naciones Unidas para prohibir o regular este tipo de tecnologías.

El papel de la IA en operaciones militares

Asaro explicó que parte de la información disponible sobre las recientes acciones militares vinculadas con Venezuela indica que sistemas de inteligencia artificial habrían sido utilizados para procesar grandes volúmenes de datos de inteligencia. Según dijo, el sistema de IA Claude desarrollado por Anthropic es actualmente el único certificado para operar en sistemas clasificados dentro del Pentágono.

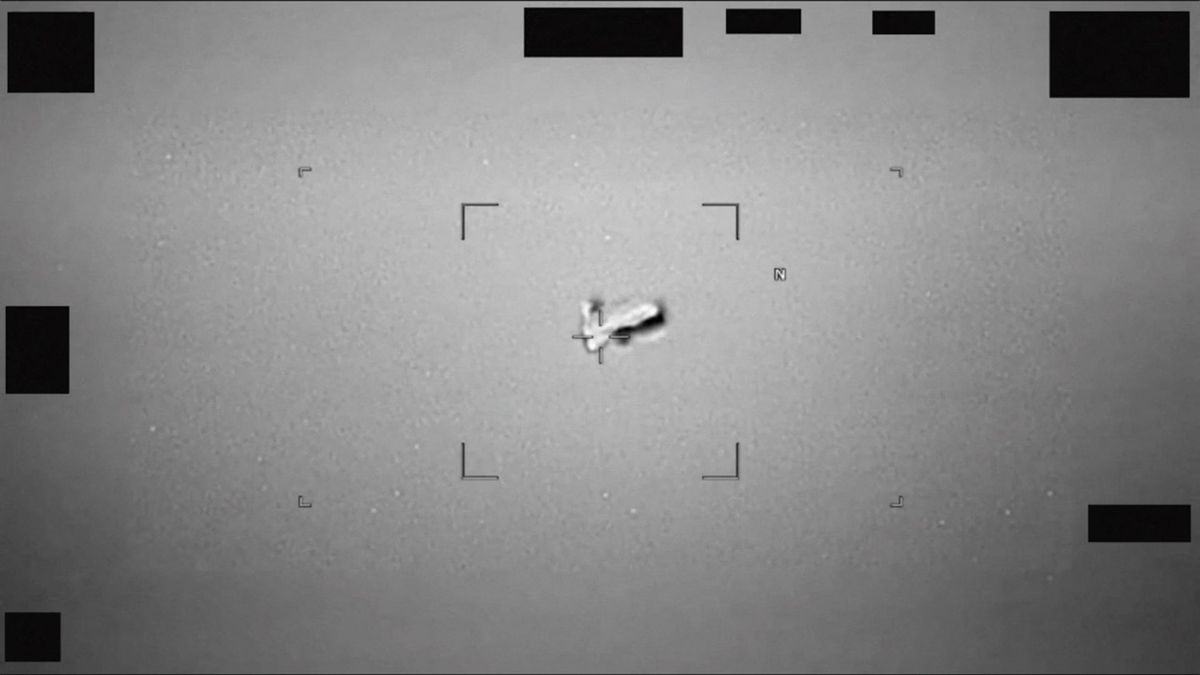

De acuerdo con lo que han reportado periodistas y analistas, esa tecnología habría sido integrada en una plataforma conocida como Maven desarrollada por Palantir Technologies que permite reunir información de múltiples fuentes para ubicar personas y objetivos militares. “Lo que parece claro es que esa inteligencia artificial fue utilizada dentro de ese sistema para recolectar inteligencia de muchas fuentes diferentes con el fin de identificar la ubicación y los movimientos de Nicolás Maduro”, explicó Asaro.

El experto añadió que el mismo tipo de procesamiento automatizado también habría permitido identificar varios de los objetivos que posteriormente fueron bombardeados durante la operación. Según dijo, estos sistemas pueden analizar información proveniente de satélites, sensores y otras fuentes para producir listas de posibles blancos militares. “También probablemente ayudó a identificar muchos de los objetivos de ataque que luego fueron bombardeados”, afirmó el investigador.

Riesgos éticos y errores en la selección de objetivos

Para Asaro, uno de los principales problemas de delegar este tipo de tareas en sistemas de inteligencia artificial es que las máquinas no tienen la capacidad de realizar juicios morales o legales. Aunque pueden ejecutar cálculos y algoritmos, sostuvo que no deberían asumir responsabilidades que corresponden a los seres humanos. “Pueden hacer cálculos y ejecutar algoritmos, pero no se les debería poner responsabilidades morales y legales porque no son agentes morales”, explicó durante la entrevista.

El especialista advirtió además que uno de los mayores riesgos aparece cuando estos sistemas se emplean en zonas urbanas densamente pobladas. En esos entornos las decisiones sobre atacar un objetivo militar pueden implicar poner en riesgo a civiles, una evaluación que según él las máquinas no están en condiciones de realizar. También mencionó que errores en las bases de datos o información desactualizada pueden influir en la selección de objetivos militares.

En ese sentido, Asaro citó reportes sobre un ataque ocurrido en Irán contra una escuela donde murieron más de 170 estudiantes. Según explicó, una posible causa sería que la inteligencia utilizada para seleccionar el objetivo estaba basada en información antigua que señalaba que el lugar había sido una instalación militar años atrás.

A partir de estos casos, el investigador insistió en que el uso de inteligencia artificial en operaciones militares plantea preguntas fundamentales sobre la capacidad humana para supervisar y controlar.